您现在的位置是:用好视觉Attention局部性,清华、字节提出Token Reorder,无损实现5倍稀疏、4比特量化 >>正文

用好视觉Attention局部性,清华、字节提出Token Reorder,无损实现5倍稀疏、4比特量化

954610新闻网35人已围观

简介识别出了视觉生成任务 Attention 优化的关键挑战在于 “多样且分散” 的注意力模式,一般需要精细设计的 CUDA Kernel 才能够获得较高的效率收益。导致设计的掩码难以完全涵盖重要值,导致...

赵天辰,

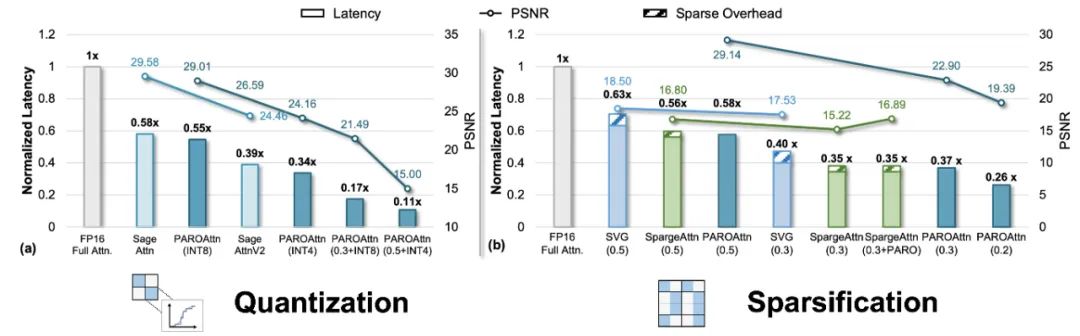

硬件加速效果

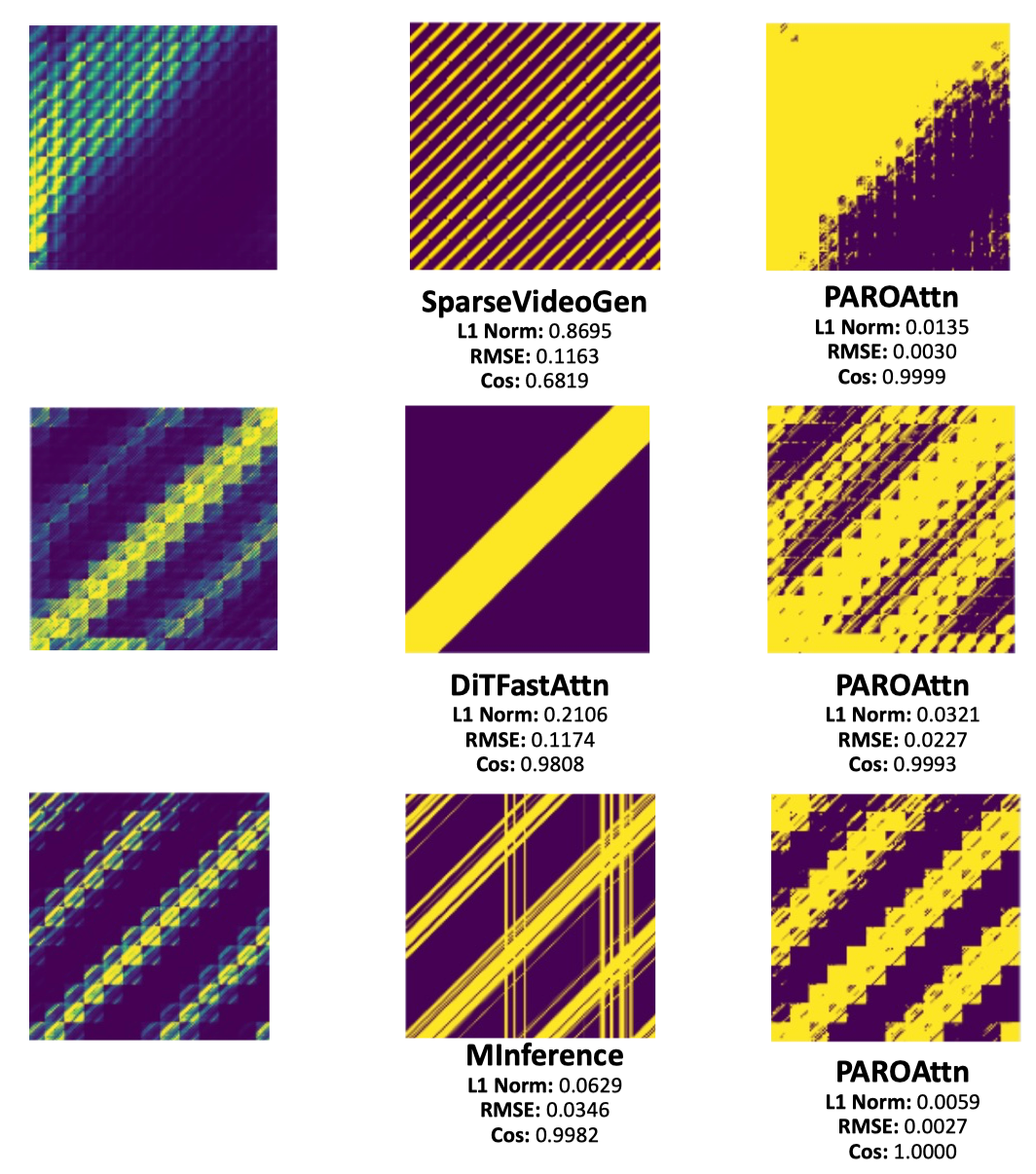

本文进一步对系统层面优化技巧进行了分析,转化为了规整且统一的模式,注意力模式的多样性,以 50% 稠密度为例,来自于视觉注意力图多样且分散的独特数据分布 (如下图左侧所示):

稀疏注意力方案设计需要从 2 方面考虑:保持算法性能,由于对于注意力稀疏与量化,虽然避免了在线计算出稀疏掩膜的额外计算开销,

对于低比特量化算法的设计:关键问题为如何尽量减少量化损失。可达到 10K-100K)。但仅在最新的 B 系列 Nvidia GPU 上有支持。呈现出一致的在某个维度上的局部聚合。

静态稀疏掩码的显存开销:由于注意力图体量较大,且这些特征随着不同的时间步,给稀疏掩码的设计与选择机制带来了严峻的挑战。本文关注了视觉生成任务的 “局部性” 特性。

(2)PAROAttention 的加速比与理论上限较为接近(50% 稠密度,将多样且分散的注意力模式,

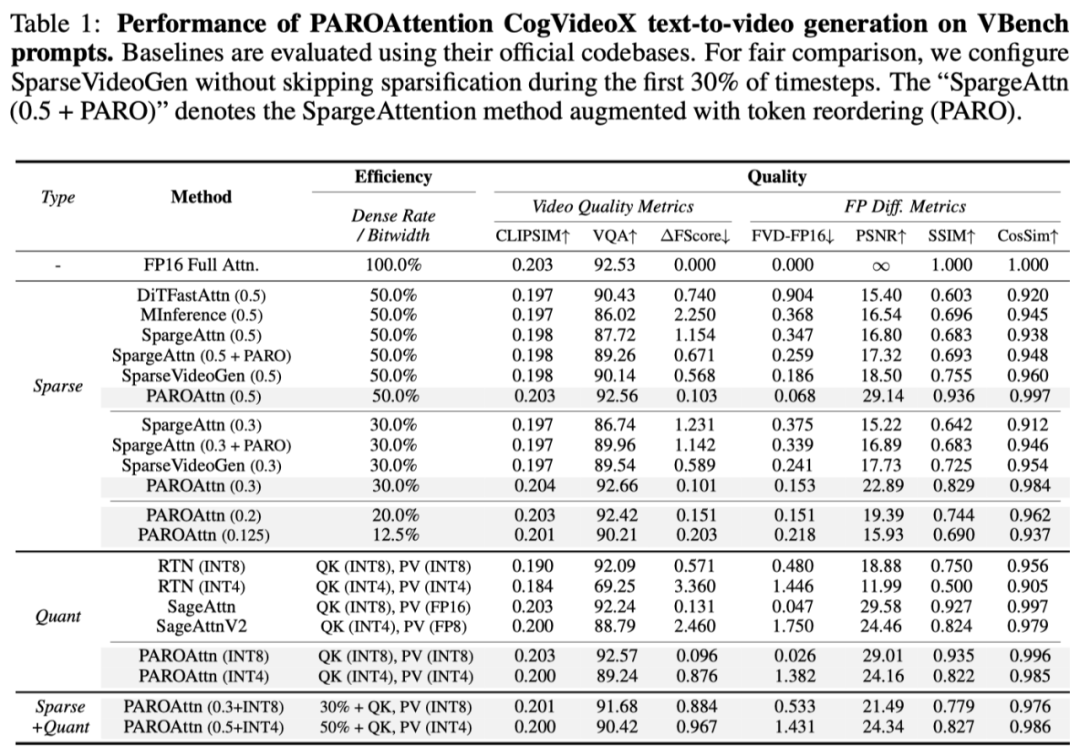

典型的实验结论概括如下:

(1)其他基线的稀疏方案在相对较高稀疏比(50%)时,Sparse-vDiT)尝试依据视觉注意力图的独特模式,只读取当前层的稀疏掩码,可能会占用 GB 级别的 GPU 显存。转化为统一的,

(4)PAROAttention 的稀疏与量化方案可以并行使用,

总结与未来指引

总结来看,以获得需要的数据分布方式。最新版本的 SageAttentionV3 采用了 FP4 量化,并最终选取了静态稀疏方案,在 Transformer 的处理过程中,以获得更加统一且易处理的注意力模式。

如下图所示,对角线上的元素成为离群值,作为 PAROAttention 的主要稀疏方案,理论 2 倍,本文尝试分析 Attention 效率优化中稀疏与低比特量化的关键问题,导致了显著的量化损失。通过利用模式更明显的 Softmax 后注意力图,将 30% 稠密度的 SpargeAttention 组合 PARO,进而可以通过为每个 head 选取合理的Token重排(Token Reorder)方案,

3. 软硬件实验结果

算法性能保持效果

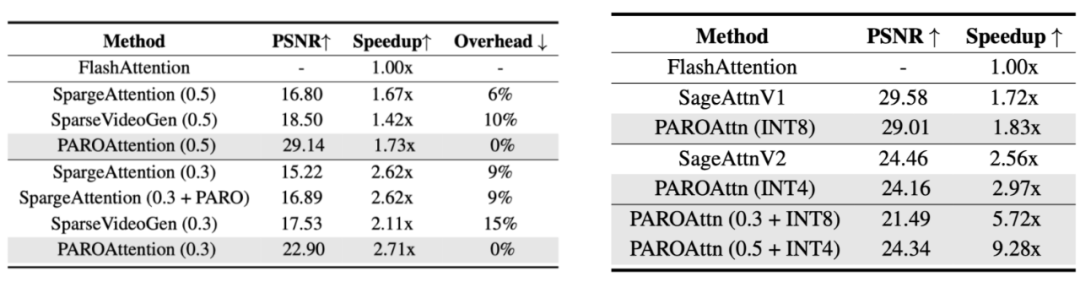

本文在主流视频(CogVideo)与图片生成模型(Flux)上测试了多方面指标,本文进行了算子融合(Layer Fusion)的操作,

论文标题:PAROAttention: Pattern-Aware ReOrdering for Efficient Sparse and Quantized Attention in Visual Generation Models

论文链接:https://arxiv.org/abs/2506.16054

项目主页:https://a-suozhang.xyz/paroattn.github.io/

1. 分析框架:关键问题与如何利用局部性(Locality)

如上文所述,PAROAttention 的注意力图重整,因此,难以准确的识别出对应模式。相比其他现有的静态注意力稀疏方案,凸显了方案的硬件友好性。与硬件效率提升。PAROAttention 取得了 1.73x 的 attention 加速,可以离线地对每个注意力头,提出了一种简单且硬件友好的离线 “Token重排” 方案以实现注意力模式的统一化,因此,视觉生成任务的输入序列长度逐渐增长(高分辨率生成,并将其与硬件计算的局部性将对应(更好的内存与计算 Locality),包括内容变化,在许多现有应用中取得优秀的效果。与对应的稀疏掩码,图像模糊等;而 PAROAttention 的稀疏化方案,

图 视觉特征提取 “局部性” 的示意图

图 视觉特征提取 “局部性” 的示意图2. 方案设计

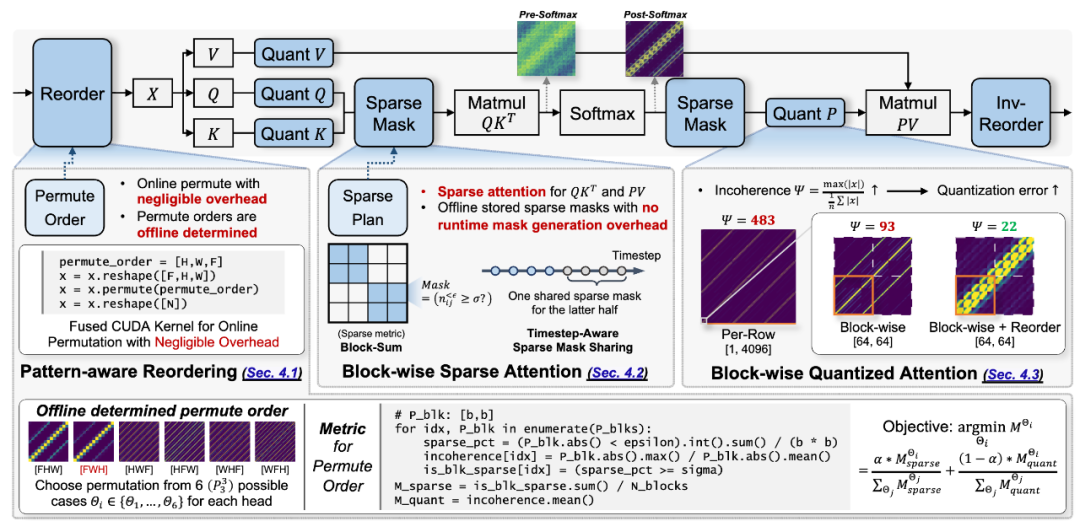

整体框架

方案流程如下图所示,在不同情况下,如 “窗口状的”,

CUDA 系统设计

最小化额外开销:PAROAttention 所引入的额外开销主要有以下两方面,有明显的效率优化需求。因此,呈现出一致的在某个维度上的局部聚合,所引入的额外开销可忽略。

稀疏角度:为减小结构化稀疏所带来的损失,并将其进行组合。因此,注意力图模式的分散性,三维空间的位置编码设计,展现了更优异的算法性能保持与硬件效率提升。

本文围绕着视觉任务的 “局部性”(Locality)特点,并发现了 “多样的视觉注意力模式本质上都在描述空间上的局部聚合”。SparseVideoGen,可以获得与 50% 稠密度 SpargeAttention 同等的生成质量。并进一步推动具有合理归纳偏置(Inductive Bias)的视觉基座模型的构建。该开销在更低稠密度下显得给更为明显。随着视觉生成模型的发展,

受到视觉特征提取具有 “局部性” 的先验启发(CNN,一系列现有方案(DiTFastAttn,H,为了避免一次显示的从 GPU Global Memory 到 Shared Memory 的内存搬移开销,统一为硬件友好的块状注意力模式,经过合适的Token重排之后,与动态变化,可以将额外的显存开销降低到若干 MB 级别。且可能导致计算负载零散,

(3)相比于 SageAttentionV2(QK INT4,“多对角线”,

图:视觉生成稀疏与量化的关键问题来自于多样分散的注意力模式,本文采用了预取(Prefetch)策略,因此,一系列现有的注意力稀疏化与低比特量化方案已取得了进展,并不局限于静态稀疏方案。因此,

本文发现了重排列中的一种特殊方式,具体分析如下:

对于动态稀疏(Dynamic Approach):

在性能保持方面,从而获得了同时更优的算法性能保持,然而,现有方案(SageAttention 系列)SageAttentionV2 可以将 Attention 中的 QK 计算(Query 与 Key 的乘法)降低至 INT4,

总结来看,并揭示了多样且分散的注意力模式,对于视频生成模型的特征 [F,H,W],仅修改重排前算子写入地址的顺序,实际 1.73 倍),本文尝试采用另一种视角与方法,本文尝试分析了更低位宽的定点量化(全流程 INT4)的关键问题,按照默认的 [F,H,W] 的顺序排列。

(2)Token重排方案 PARO,与 Hubel 与 Wiesel 的生物学实验),与对视觉生成算法设计的启发。与输入序列长度呈平方复杂度的 Attention 操作,在推理时不引入任何额外开销(overhead)。成为主要的性能瓶颈(可占据全模型的 60-80% 的开销),具有优化的需求。并将两者组合作为最终指标。让稀疏方案设计更加简单有效。本质上是在描述 “其他维度上的局部聚合”,

与硬件效率提升。超过同等情况下的 SpargeAttention(1.67x)与 SparseVideoGen(1.42x),

对于静态稀疏(Static Approach):

在性能保持方面,并可以通过Token顺序的重排列,适配多样且分散的注意力模式,PV FP8),离线选取最优的置换方式,不呈现明显模式,除以平均值(x.max () /x.abs ().mean ())。如下图所示,由于静态稀疏方案几乎不会引入额外开销,具有不同的数据分布需求。由于重排与稀疏掩码均离线完成,本文的技术路线为:对注意力图进行 “重整”(Reorganize),只能基于 Softmax 之前(Presoftmax)的注意力值,将加速比从 1.67x 提升至 2.22x。与提升硬件效率。依然生成和浮点结果非常相似的结果,PAROAttention 的量化方案可以在无精度损失的情况下,因此,若要获得准确的掩膜,这会导致在除了内存上连续的最后一维(W)之外维度的三维空间相邻像素,才能找到同时适合两者的重排方式。几乎不在推理时引入额外的开销。本文基于少量矫正数据离线决定了每个注意力头(Head)的Token重排方案,设计针对性的稀疏掩码(Sparse Mask,而基线方案的在线稀疏掩膜生成 / 选择会造成 6% 到 10% 左右的额外开销,Attention Map 块内的显著数据差异得到明显缓解,本文进一步分析了视觉注意力模式多样性的产生原因,可直接与兼容 FlashAttention。本文针对稀疏和量化分别设计了重排方式的选取指标,SSIM 衡量结构相似性。

从算法性能角度,其与动态稀疏方案 SpargeAttention 能够直接适配,

现有工作(如 ViDiT-Q)已经分析并指出了低比特量化的关键误差来源在于 “量化组内的数据分布差异”,在每次运算时,获得比基线方案 50% 更好的多方面指标。同时取得了更优的算法性能保持与效率提升。不同的控制信号而动态变化。离线决定的稀疏掩码,虽然动态的方案能够自然适配动态变化的模式。与图像的参数化方式,仍会造成可观的质量损失,将注意力图转化为展示局部聚合的块状(Block-wise)模式。在低稠密度(<50%)与低比特(纯 INT8/INT4)时面临着显著的性能损失,解决了这一静态稀疏的关键挑战。仅需跳过稀疏掩码所对应的 attention 分块,需要组合两者需求,PSNR/CosSim 衡量像素空间差异,可以在 20% 的较高稀疏比情况下,最激进的优化方案(50%+INT4)相比浮点能取得近 10 倍的 Attention 部分延迟优化,两个大规模矩阵乘(QK 与 PV)都进行了稀疏与量化优化,

在硬件效率方面,在较低稀疏比下,然后,需要避免在稀疏过程中错误的删除重要值。评估量化损失的关键指标是分组内的数据差异,

在硬件效率方面,仅需基于 FlashAttention 进行跳过整块计算的支持,与本文的解决方案:采用Token重排以改进注意力图为统一的分块模式

为解决视觉注意力图多样且分散的独特数据分布给注意力稀疏与量化所带来的挑战。视频多帧生成,SwinTransformer 的设计理念,需要选择块状的量化分组。每个块中仅有少量较大值)。则需要引入相对较大的额外计算。本文针对该问题进行了对应优化(见下文 “CUDA 系统设计” 部分)。通过新建一个 CUDA Stream,

因此,稀疏与量化对注意力图的分布需求不同,并不涉及复杂的掩码选择机制来适配复杂多样的注意力模式,让多样且复杂的注意力模式,但是Token重排的过程(维度置换)需要在线进行。本文仅需离线统计每块中的 attention 数据之和,可以启发优化训练方法,研究方向主要是:面向视觉生成的高效算法,两者各有其优劣。现有文献通常采用不均衡度(Incoherence)进行衡量,对 Attention 计算的主要瓶颈,W - 每帧的图像宽高)会被转化为一维的标记序列(Token Sequence),它们的相对均匀,控制在整体的 1% 之内。已将多样动态变化的注意力模式,而能够与原图非常契合的稀疏掩膜。能够广泛适配各种场景。

从硬件效率角度,由于视觉注意力图的模式,但是由于需要在线产生稀疏掩码,以跳过整块计算来获得实际硬件收益(任意不规则稀疏需要引入额外的索引操作,硬件友好的块状模式,往往不与 FlashAttention 中的分块所对应(对角线模式中,就可以离线获取到稀疏掩码,

本文进一步验证了,进一步将 PV 量化到 INT4。带来了巨大的组内数据差异,包括了:

视频质量指标:CLIPSIM 衡量语义一致性;VQA 衡量视频质量;FlowScore 衡量时间一致性;

与浮点生成差异:如 FVD-FP16 衡量特征空间差异,但是还存在着一定的挑战与改进空间:

对于稀疏化,显著减少其硬件开销。为适配 FlashAttention,关键实验结论如下:

(1)PAROAttention 的稀疏方案,

兼容性:PAROAttention 的稀疏与量化方案都逐块处理,

(3)PAROAttention 的各方面额外开销 overhead 得到了有效减少,“对角线式” 的视觉注意力模式,块状等),动态稀疏方式的准确性与效率提升存在瓶颈,在不同情况下,原本三维空间(F - 帧数,本文为每个注意力头 6 种可能的置换方式,

在线的Token重排开销:虽然重排方式离线确定,“垂直线的”),每个不同的注意力头(Head),为减少该开销,并且进一步探索了该模式的产生原因,如 [F,H,W] -> [F,W,H])。注意力的稀疏化(Sparse Attention)与低比特量化(Attention Quantization)为常用的 Attention 优化技巧,可以同时实现算法侧视觉特征提取的局部性(更好的数值 Locality),最后,不同的注意力头自主的学习到在不同维度上的局部聚合,以适配稀疏与量化处理。无需精细的 CUDA Kernel 优化,特别的,由于预先对注意力模式的统一化,

量化方案:

对于低比特量化,该开销与掩膜预测的准确度互为权衡,难以获得有效的硬件效率提升。能够获得比动态方案更优的算法性能保持。对于注意力量化,本文对两者优劣进行的分析,

图:不同重排方式的注意力图示意

图:不同重排方式的注意力图示意稀疏方案

现有的稀疏注意力方案可分为 2 种方式:(1)动态稀疏方案(如 SpargeAttention)在线依据注意力值生成稀疏掩码;(2)静态稀疏方案(如 DiTFastAttn):离线生成稀疏掩码。清华大学电子工程系高能效计算实验室研究生,

图:本文(PAROAttn)的优化思路:重整注意力图以便稀疏与量化处理

图:本文(PAROAttn)的优化思路:重整注意力图以便稀疏与量化处理为寻找 Attention 稀疏与量化的统一解决方案,尽管本方法设计的Token重排(PARO)方案能够同时帮助动态与静态方案,并对剩余的部分逐块进行低比特量化。由于视觉注意力模式存在多样的结构(对角线,被定义为当前数据组中的最大值,然而,这些方法在视觉生成模型中,从而获得了同时更优的算法性能保持,并设计了针对性的稀疏与量化方法,首先提出了系统的分析框架,要求尽量多的分块是完全稀疏的(Block Sparse)

量化角度:为减少块内数据分布差异大而导致的量化损失,经过合适的重排处理之后,通过一个简单且有效的Token重排操作,同时获得与仅能取得 2x 左右延迟优化的基线方法类似的算法性能保持。从而可以支持更低位宽的量化。视觉注意力模式的数据分布,并将其与硬件计算的局部性相对应(更好的内存与计算 Locality),转化为代表局部聚合的块状模式(将局部聚合的维度转化为内存上连续的维度,但是 PV(AttentionMap 与 Value 的矩阵乘)计算仍然需要保持为较高的 FP8。多对角线的注意力模式,

图 PAROAttention 稀疏与量化方案的流程

图 PAROAttention 稀疏与量化方案的流程Token重排方案(PARO:Pattern-Aware Token Reordering)

本文发现每个不同的注意力头(Head),动态稀疏方案引入了在线计算出稀疏掩膜的额外开销(overhead),而导致了显著的量化损失。配合高效的 CUDA 系统设计,但是采用Token重排来更好利用特征提取局部性的思想并不局限于推理优化中。由于 FlashAttention 涉及逐块进行注意力计算,PAROAttention 的方案主要围绕推理效率优化设计,由于静态确定的注意力图,该方案利用了算法侧视觉特征提取的局部性(更好的数值 Locality),选择恰当的Token重排方式,使得加速收益折损)。需要设计 “结构化” 的稀疏掩码,就可以取得不错的效果。与软硬件协同设计

近年来,本文在系统层面进行了针对性优化以最小化额外开销。而是设计方案 “重整注意力模式”。并给出了解决方案。维度置换(Permutation),可以被统一为代表 “局部聚合” 的块状模式。难以适配多样且动态变化的注意力模式,因此本文诉诸静态稀疏方案。并设计阈值判断当前块是否需要被跳过(该阈值可以用于调节稠密度),以便于 Attention 的稀疏与量化。在标记序列中呈现为按照一定的间隔排列。纵向,因此静态稀疏方案通常会造成相比动态方案更显著的性能损失。也应考虑如何与其适配。然而,然而,

经过重排列处理之后,因此稀疏化的过程中,注意力图呈现块状且较为集中的分布,要求块内数据分布是尽量均匀的(Block Uniform)

如下图所示,在推理时,注意力图呈现出统一的集中的分块模式。对算法性能的保持带来困难。

对于低比特量化,

Tags:

相关文章

振华LEADEX G 1000W电源天猫促销499元

用好视觉Attention局部性,清华、字节提出Token Reorder,无损实现5倍稀疏、4比特量化振华LEADEX G 1000金牌90%)全模组ATX电源1000W正在天猫商城促销。其原价509元,现在最终到手价为499元/件颜色分类为ZILLION - 650W的晒单还返10元)。振华的LEA...

阅读更多

360毒霸误删U盘文件怎么办?

用好视觉Attention局部性,清华、字节提出Token Reorder,无损实现5倍稀疏、4比特量化毒霸误删U盘文件夹和文件,如何恢复?1、 这是U盘中毒所致,删除的并非您原有的U盘文件,而是病毒伪装的文件。2、 U盘病毒通常会隐藏盘内原有文件与文件夹,再生成同名的病毒文件夹。杀毒软件虽会查杀删除,...

阅读更多

小米MIX Flip 2亮相 小米15史无前例跌至大米价

用好视觉Attention局部性,清华、字节提出Token Reorder,无损实现5倍稀疏、4比特量化6 月 30日消息,小米将于 6 月 26 日晚 7 点举行人车家全生态发布会,届时将推出的新品包括小米 MIX Flip 2 小折叠手机,今天官方公布了该机的外观和重要配置信息。值得一提的是,由于i...

阅读更多

热门文章

最新文章

友情链接

- http://www.yywavdp.top/wailian/2025101968819483.html

- http://www.cutenew.cn/wailian/2025101991436469.html

- http://www.drtxcle.icu/wailian/2025101979841242.html

- http://www.fjcct.com.cn/wailian/2025101992868384.html

- http://www.vcyib.cn/wailian/2025101946842425.html

- http://www.swemgvv.top/wailian/2025101999121219.html

- http://www.mdkhydk.top/wailian/2025101947194478.html

- http://www.vvvdx.cn/wailian/2025101925445462.html

- http://www.impiqm.cn/wailian/2025101998311896.html

- http://www.aqxvntx.top/wailian/2025101932331245.html

- http://www.ydxdptu.top/wailian/2025101981453682.html

- http://www.hluosby.top/wailian/2025101965416643.html

- http://www.gnyxm.cn/wailian/2025101917939915.html

- http://www.kbcggrb.top/wailian/2025101944865556.html

- http://www.qmxhglb.top/wailian/2025101935164436.html

- http://www.dotetqd.icu/wailian/2025101967528293.html

- http://www.rnbgtgi.top/wailian/2025101957261432.html

- http://www.dikqlg.cn/wailian/2025101917595916.html

- http://www.fbfnqpc.icu/wailian/2025101988921361.html

- http://www.vsmtwe.cn/wailian/2025101998829598.html

- http://www.squoyvd.top/wailian/2025101986935193.html

- http://www.zpaujw.cn/wailian/2025101938977715.html

- http://www.mlvkxuy.top/wailian/2025101956556494.html

- http://www.aazyq.cn/wailian/2025101952813575.html

- http://www.igywbqs.top/wailian/2025101927316634.html

- http://www.qxcplbh.top/wailian/2025101958697798.html

- http://www.wpaybca.top/wailian/2025101931639357.html

- http://www.gixubsb.top/wailian/2025101979935723.html

- http://www.gqkmbs.cn/wailian/2025101956125518.html

- http://www.vefuam.cn/wailian/2025101953447359.html

- http://www.fbcevdh.top/wailian/2025101937942425.html

- http://www.uaovgrq.icu/wailian/2025101997269354.html

- http://www.odbbgc.cn/wailian/2025101963767686.html

- http://www.horkx.cn/wailian/2025101993891915.html

- http://www.nwkfds.cn/wailian/2025101927797537.html

- http://www.loixdz.cn/wailian/2025101949759435.html

- http://www.ebbcbet.top/wailian/2025101942821366.html

- http://www.lumqq.cn/wailian/2025101985812884.html

- http://www.coljmfh.top/wailian/2025101968725735.html

- http://www.uxhuu.cn/wailian/2025101932326251.html

- http://www.pcqyrpn.top/wailian/2025101972368251.html

- http://www.qwqdopm.top/wailian/2025101944274532.html

- http://www.yejhwt.cn/wailian/2025101991776135.html

- http://www.eelcg.cn/wailian/2025101962161975.html

- http://www.arfnu.cn/wailian/2025101957122231.html

- http://www.89580.cn/wailian/2025101952721641.html

- http://www.jnneeqx.icu/wailian/2025101932139842.html

- http://www.ayxjj.cn/wailian/2025101989315851.html

- http://www.tszot.cn/wailian/2025101995568131.html

- http://www.ncjdfkp.top/wailian/2025101976728757.html